近日,天津工业大学计算机科学与技术学院青年教师刘那与的论文“Multimodal Cross-lingual Summarization for Videos: A Revisit in Knowledge Distillation Induced Triple-stage Training Method”被《IEEE模式分析与机器智能汇刊》(IEEE Transactions on Pattern Analysis and Machine Intelligence,IEEE TPAMI)录用。

IEEE TPAMI是中国计算机学会(CCF)和中国自动化学会(CAA)等多个学会共同推荐的人工智能领域国际顶级期刊,每年录用量仅200篇左右,2024年最新影响因子为20.8,在所有计算机工程、电子工程及人工智能相关期刊榜单上以165分的h5-index排在第1位。

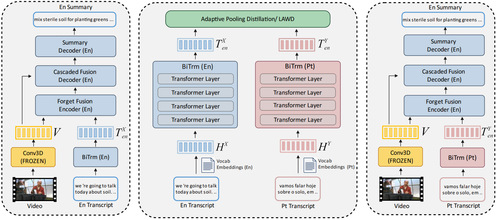

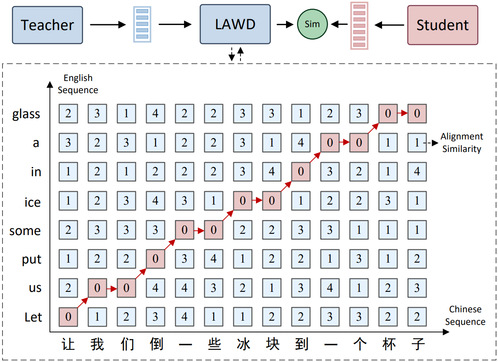

多模态摘要旨在从视觉和文本多源信息中生成摘要,有助用户在海量繁杂的多模态文档中快速定位核心内容,提升信息获取、检索、分发效率。而在多模态源文档和目标摘要语言不一致的跨语言交流场景中,由于高注释成本的跨语言样本的不足,多模态跨语言摘要模型往往性能发挥受限。针对这一问题,作者提出一种知识蒸馏引导的三阶段训练方法(图1),其通过跨语言知识蒸馏从资源丰富数据上训练的单语多模态摘要模型中转移知识,来辅助资源受限的跨语言多模态摘要模型学习。该研究还引入一种语言适应的扭曲蒸馏方法(图2),其旨在解决知识蒸馏时平行跨语言序列长度不等的挑战,不同于通过平均、池化、填充或截断等策略将不同长度的平行语言特征序列强制转为相同形状后再进行蒸馏的方式,所提出方法在保持原有语言特征形状位置不变下直接转移知识,从而避免知识蒸馏过程中因语言特征结构被破坏而带来的潜在信息损失。实验表明,所提出方法可通过从多模态同语摘要模型转移知识来为多模态跨语言摘要模型带来显著的性能改进。

(审稿:计算机科学与技术学院 楼稚明 郭永峰 编辑:党委宣传部 张莘苑)

图片来源:计算机科学与技术学院